---

id: 2024-11-10-das-osi-modell-eine-detaillierte-einfuehrung-in-die-7-schichten

slug: das-osi-modell-eine-detaillierte-einfuehrung-in-die-7-schichten

title: "Das OSI-Modell: Eine detaillierte Einführung in die 7 Schichten"

excerpt: "Meistere das OSI-Modell: Eine praxisnahe Reise durch die 7 Schichten der Netzwerkkommunikation. Mit konkreten Linux-Beispielen, Troubleshooting-Tipps und Tools wie Wireshark und tcpdump – ideal für Einsteiger und Admins."

date: "2024-11-10T09:00:00+01:00"

updated: "2026-01-18T10:00:00+01:00"

author:

name: "Laszlo Kovacs"

handle: "lkovacs"

category: ["netzwerk"]

tags: ["netzwerk", "osi-modell", "7-schichten", "linux-netzwerk", "protokolle", "troubleshooting", "systemintegration", "tcp-ip"]

toc: true

reading_time: 18

---

Stell dir vor, du baust ein Netzwerk auf – vielleicht für ein kleines Unternehmen oder ein Heimlabor mit Linux-Servern. Du hast Geräte wie `Switches`, `Router` und `Server`, die miteinander kommunizieren sollen. Aber wie stellst du sicher, dass alles reibungslos läuft? Hier kommt das OSI-Modell ins Spiel. Es ist wie ein Bauplan, der die Netzwerkkommunikation in sieben klare Schichten unterteilt, damit du verstehst, was wo passiert.

Als angehender Fachinformatiker für Systemintegration hilft dir das Modell, Probleme systematisch zu lösen, statt im Dunkeln zu tappen.

Was genau ist das OSI-Modell? Es steht für Open Systems Interconnection und ist ein theoretisches Rahmenwerk, das beschreibt, wie Daten in einem Netzwerk von einem Gerät zum anderen wandern. Jede Schicht hat eine spezifische Aufgabe, von der physischen Übertragung der Bits bis hin zur Anwendung, die du als Benutzer siehst. Warum ist das relevant für dich? Weil es dir hilft, Netzwerkprobleme zu isolieren.

**Zum Beispiel:** Wenn deine Linux-Maschine keine Webseite laden kann, checkst du schrittweise die Schichten – ist das Kabel defekt [Schicht 1](#layer-1-bitbertragungsschicht){.badge-link-text}, oder liegt's am Routing [Schicht 3](#layer-3-vermittlungsschicht){.badge-link-text}? Das spart Zeit und Nerven in der Praxis.

💡 **Tipp:** Denk an das OSI-Modell wie an eine Zwiebel – jede Schicht umhüllt die nächste, und Daten werden schichtweise "verpackt" beim Senden und "ausgepackt" beim Empfangen. Das macht es leichter, den Prozess zu visualisieren.

## Shortinfo

Lass uns tiefer eintauchen in die Geschichte, um zu verstehen, warum dieses Modell entstanden ist. In den 1970er Jahren waren Netzwerke ein Chaos. Jeder Hersteller – denk an [IBM](https://de.wikipedia.org/wiki/IBM){.badge-link-text}, [DEC](https://de.wikipedia.org/wiki/Digital_Equipment_Corporation){.badge-link-text} oder [Apple](https://de.wikipedia.org/wiki/Apple){.badge-link-text} – hatte eigene, proprietäre Systeme. Ein [IBM-Netzwerk](https://de.wikipedia.org/wiki/PC-Netzwerk){.badge-link-text} konnte nicht mit einem DEC-System sprechen, weil es keine gemeinsamen Standards gab. **Das führte zu isolierten Inseln:** Du konntest Daten nicht einfach austauschen, und Erweiterungen waren teuer und kompliziert.

Um das zu ändern, hat die International Organization for Standardization (ISO) das OSI-Modell entwickelt. Es wurde `1984` finalisiert und sollte eine offene, standardisierte Basis schaffen, damit Geräte unterschiedlicher Hersteller nahtlos zusammenarbeiten.

Stell dir vor: Vor OSI warst du an einen Anbieter gebunden, wie in einer geschlossenen Welt. Nach OSI öffnete sich alles – Netzwerke wurden interoperabel, und Innovationen boomten.

**Vor OSI (1970er Jahre):**

```Markdown

┌──────────┐ ╳ ┌──────────┐ ╳ ┌───────────┐

│ IBM-Netz │ ──╳── │ DEC-Netz │ ──╳── │Apple-Netz │

└──────────┘ ╳ └──────────┘ ╳ └───────────┘

╳ ╳ ╳ ╳ ╳

╳─────────╳─────────╳────────╳────────╳

Keine Kompatibilität – proprietäre Systeme

```

**Nach OSI (ab 1980er Jahre):**

```Markdown

┌──────────┐ ═ ┌──────────┐ ═ ┌──────────┐

│ System A │ ═════ │ System B │ ═════ │ System C │

└──────────┘ ═ └──────────┘ ═ └──────────┘

║ ║

║ Offene, standardisierte ║

║ Kommunikation ║

║ ║

╚══════════════════════════════════════╝

```

🔧 **Praktisches Beispiel:** In deiner Linux-Admin-Rolle siehst du das heute in Tools wie `tcpdump` oder `ip link show`. Diese basieren auf OSI-Prinzipien, um Schichten zu analysieren. Ohne das Modell wärst du verloren, wenn du ein Netzwerkproblem debuggst.

Ein wichtiger Punkt: Das OSI-Modell ist theoretisch, im Gegensatz zum TCP/IP-Modell, das praktischer und im Internet dominant ist. `TCP/IP` hat nur vier Schichten (`Application`, `Transport`, `Internet`, `Link`), die den OSI-Schichten 5-7, 4, 3 und 1-2 entsprechen. Warum lernen wir OSI trotzdem? Weil es detaillierter ist und hilft, Konzepte zu verstehen – selbst wenn du in der Praxis `TCP/IP` nutzt.

Zum Beispiel mappt `HTTP` (OSI Layer 7) auf die TCP/IP-Application-Schicht.

❗ **Typische Fehlerquelle:** Viele Einsteiger verwechseln OSI mit TCP/IP. Merke dir: OSI ist der Lehrer, der erklärt; TCP/IP ist der Arbeiter, der baut. In Linux-Szenarien, wie bei der Konfiguration von `iptables` für Firewall-Regeln (Layer 3/4), hilft OSI, die Ebenen klar zu trennen.

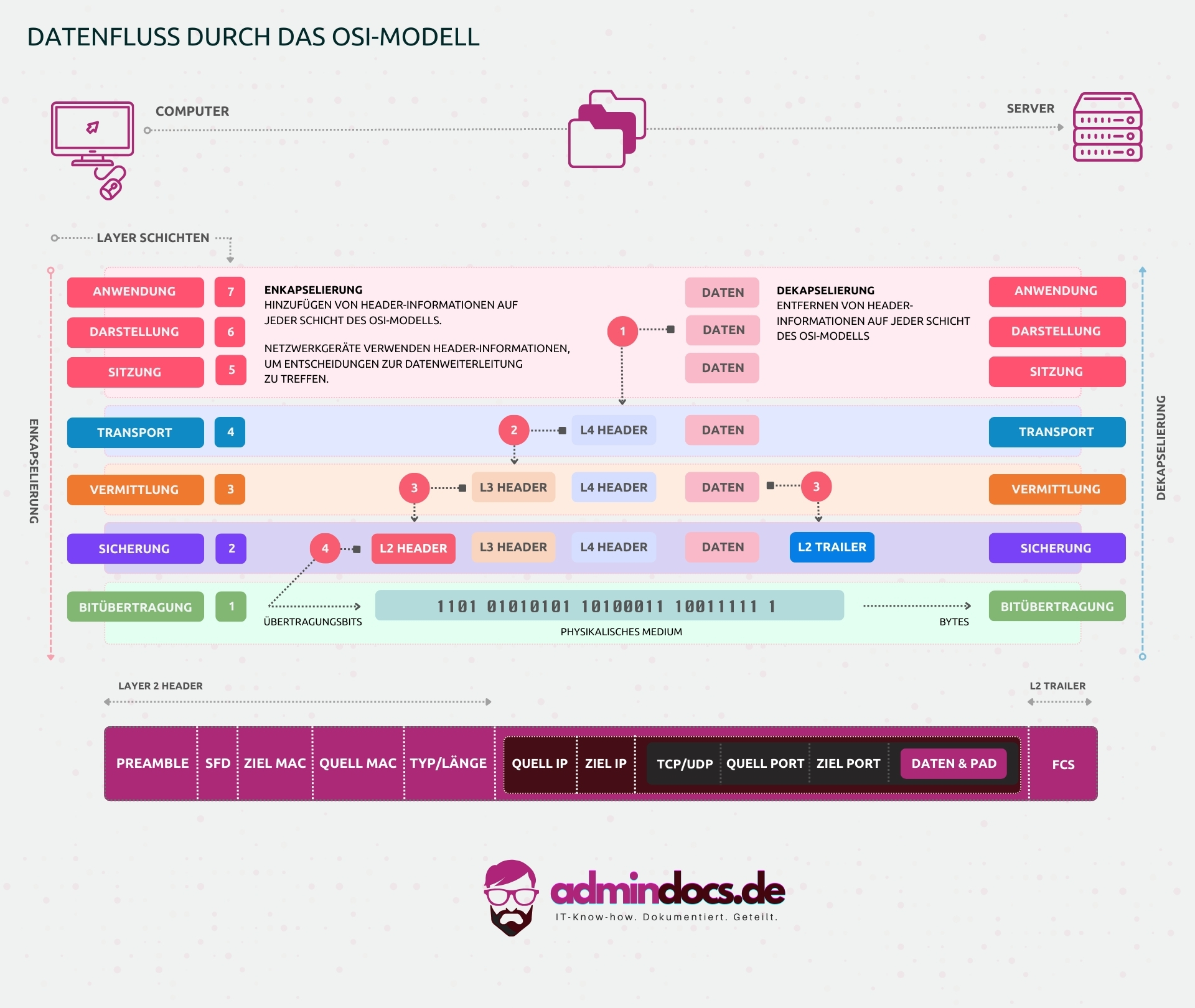

Worauf solltest du achten? Das Modell folgt einem Top-Down-Ansatz: Wir starten bei der Anwendung `Layer 7` und gehen runter zur physischen Schicht `Layer 1`. Beim Senden werden Daten "eingepackt" (Encapsulation) – jede Schicht fügt Header hinzu. Beim Empfangen passiert das Umgekehrte (Decapsulation). Das brauchst du später, wenn du Netzwerke designst oder fehler suchst.

💡 **Hinweis:** In moderner Linux-Praxis, z. B. bei Kubernetes-Clustern, hilft OSI, Container-Netzwerke zu verstehen – von Pod-Kommunikation `Layer 7` bis zu physischen NICs `Layer 1`.

## Die 7 Schichten im Detail

### Layer 7: Anwendungsschicht

**Application Layer**

Du startest hier oben, bei der Schicht, die dir als Benutzer am nächsten ist.

Die Anwendungsschicht ist der Einstiegspunkt für die gesamte Netzwerkkommunikation – sie ist quasi die Schnittstelle zwischen dir und dem Rest des Netzwerks. Hier laufen die Dienste und Protokolle, die du täglich nutzt, ohne viel darüber nachzudenken. Stell dir vor, du öffnest deinen Browser und lädst eine Webseite: Das ist `Layer 7` in Aktion. Die Schicht sorgt dafür, dass Anwendungen wie dein Webbrowser oder E-Mail-Client mit dem Netzwerk interagieren können, indem sie Daten in einem Format bereitstellt, das für die Kommunikation geeignet ist.

Was genau passiert in dieser Schicht?

Sie handhabt die Kommunikation auf Anwendungsebene, also alles, was mit den Programmen zu tun hat, die du siehst und bedienst. Die Schicht definiert, wie Anwendungen Daten austauschen, Dienste anbieten und auf Anfragen reagieren. Im Kern geht es um die Bereitstellung von Netzwerkdiensten für Endanwender-Anwendungen. Daten werden hier als `Nachrichten` oder `Requests` behandelt, die an untere Schichten weitergegeben werden.

Anders als tiefer liegende Schichten, die sich um `Bits` und `Pakete` kümmern, konzentriert sich `Layer 7` auf den Inhalt: Ist das eine E-Mail? Eine Dateiübertragung? Eine DNS-Abfrage?

Warum ist diese Schicht relevant für dich als angehender Fachinformatiker? Weil sie der Grund ist, warum Netzwerke nützlich sind – ohne sie gäbe es keine Webseiten, keine E-Mails oder Cloud-Dienste. In der Systemintegration hilft dir das Verständnis, Anwendungen zu konfigurieren und zu troubleshooten.

**Zum Beispiel:** Wenn ein Server keine HTTPS-Verbindungen akzeptiert, checkst du zuerst hier, ob das Protokoll richtig implementiert ist. Das Modell macht klar, dass Probleme in `Layer 7` oft an der Software liegen, nicht am Kabel.

💡 **Tipp:** Denk an `Layer 7` wie an die Bedienoberfläche deines Autos – du drückst auf das Gaspedal, ohne dich um den Motor zu kümmern. Aber als Admin musst du wissen, was unter der Haube läuft, um Tuning oder Reparaturen zu machen.

Worauf solltest du besonders achten? Auf die Protokolle, die hier zu Hause sind. **Wichtige Beispiele** sind `HTTP`, `HTTPS` für Webzugriff, `FTP`für Dateitransfers, `SMTP` für E-Mail-Versand, `POP3`, `IMAP` für E-Mail-Empfang und `DNS` für die Auflösung von Domainnamen in IP-Adressen.

**Jedes Protokoll hat spezifische Regeln:** `HTTP` ist stateless, also ohne Sitzungsspeicher, während `HTTPS` Verschlüsselung hinzufügt. Achte auch auf Ports – `HTTP` läuft standardmäßig auf Port `80`, HTTPS auf `443`. In Linux siehst du das in Konfigurationsdateien wie `/etc/apache2/sites-enabled/` für einen Webserver.

🔧 **Praktisches Beispiel:** Du konfigurierst einen Apache-Webserver auf Ubuntu. Du installierst ihn mit:

```bash

sudo apt update

sudo apt install apache2

sudo systemctl start apache2

```

Dann testest du mit `curl http://localhost` – das greift direkt auf `Layer 7` zu. Wenn's nicht läuft, prüfst du die Firewall mit `sudo ufw status`, da Ports blockiert sein könnten.

❗ **Typische Fehlerquelle:** Viele Einsteiger vergessen, dass `Layer 7` unabhängig von unteren Schichten ist. Ein Kabelproblem `Layer 1` blockt alles, aber ein falsches Protokoll (z.B. `HTTP` statt `HTTPS`) verursacht nur Anwendungsfehler. **Lösung:** Nutze Tools wie `netstat -tuln` oder `ss -tuln` in Linux, um offene Ports zu checken und zu sehen, welche Dienste lauschen.

Wie nutzt du das später in der Praxis? In der Netzwerkadministration baust du damit sichere Systeme auf. Zum Beispiel integrierst du `DNS` in ein internes Netzwerk mit `Bind9` auf Linux: Du bindest Domains an IPs, was `Layer 7` mit `Layer 3` verknüpft. Oder du setzt einen Reverse-Proxy mit `Nginx` auf, der `HTTPS` terminiert.

Das brauchst du, wenn du Cloud-Umgebungen wie Kubernetes managst, wo Pods über Services `Layer 7` kommunizieren. So vermeidest du Sicherheitslücken, wie unverschlüsselte Verbindungen, und skalierst effizient.

**Anwendungsschicht-Dienste**

```Markdown

┌────────────────────────────────┐

│ Benutzeranwendungen │

├────────────────┬───────────────┤

│ HTTP/HTTPS │ DNS │

│ SSH/Telnet │ SNMP │

└────────────────┴───────────────┘

│ │

▼ ▼

Web & Dateien Namensauflösung & Management

```

⚠️ **Warnung:** In Zeiten von Zero-Trust-Netzwerken achte auf sichere Protokolle – wechsle von `FTP` zu `SFTP`, da unverschlüsselte Transfers Daten preisgeben können. In Linux aktivierst du das mit `OpenSSH`.

### Layer 6: Darstellungsschicht

**Presentation Layer**

Die Darstellungsschicht, die oft unterschätzt wird, aber entscheidend dafür sorgt, dass Daten zwischen Systemen verständlich bleiben.

Sie agiert wie ein art Vermittler, der sicherstellt, dass die Informationen, die von der Anwendungsschicht kommen, in einem Format übertragen werden, das der Empfänger interpretieren kann. Stell dir vor, du sendest eine Datei von einem Linux-Server an einen Windows-Client: Ohne diese Schicht könnten Unterschiede in der Codierung – wie `ASCII` vs. `EBCDIC` oder `Big-Endian` vs. `Little-Endian` – alles durcheinanderbringen. Hier werden Daten `formatiert`, `komprimiert`, `verschlüsselt` oder `entschlüsselt`, bevor sie an die Sitzungsschicht weitergehen.

Was genau passiert in dieser Schicht?

Sie übernimmt die Syntax- und Semantikverarbeitung der Daten. Das bedeutet, sie wandelt die anwendungspezifischen Daten in ein neutrales Format um, das netzwerkübergreifend kompatibel ist. Beim Senden fügt sie Header hinzu, die Informationen über `Codierung`, `Kompression` oder `Verschlüsselung` enthalten. **Beim Empfangen dreht sie das um:** Sie `dekodiert`, `dekomprimiert` und stellt sicher, dass die Daten für die obere Schicht nutzbar sind.

Protokolle wie `SSL`, `TLS` (obwohl oft mit `Layer 7` assoziiert, wirkt es hier für Verschlüsselung) oder Formate wie `JPEG` für Bilder und `MPEG` für Videos spielen eine Rolle. In Linux siehst du das bei Dateiübertragungen, wo Tools wie `iconv` Zeichensätze konvertieren, um Kompatibilitätsprobleme zu vermeiden.

Warum ist diese Schicht relevant? Sie verhindert Missverständnisse in heterogenen Umgebungen, wie in einem gemischten Netzwerk mit Linux, Windows und macOS. Ohne sie wären Cross-Plattform-Übertragungen chaotisch – denk an E-Mails mit Anhängen, die auf einem System korrupt ankommen.

In der Systemintegration hilft dir das, stabile Dienste aufzubauen, besonders bei Cloud-Migrationen oder IoT-Setups, wo Geräte unterschiedliche Formate nutzen. Es schützt auch vor Sicherheitslücken, indem es Verschlüsselung handhabt, was in Zeiten von Datenschutzvorschriften wie `DSGVO` essenziell ist.

💡 **Tipp:** Denk an `Layer 6` wie an einen Dolmetscher, der sicherstellt, dass beide Seiten dieselbe Sprache sprechen. Als Admin musst du wissen, welche Sprachen (Formate) dein Netzwerk versteht, um Datenverlust zu vermeiden.

Worauf solltest du besonders achten? Auf Kompatibilitätsfallen wie Zeichensatz-Unterschiede (`UTF-8` ist Standard in Linux, aber ältere Systeme könnten`ISO-8859` nutzen) oder Byte-Reihenfolge in Prozessoren. Achte auch auf Kompressionsalgorithmen wie `gzip` oder `deflate`, die Bandbreite sparen, aber Overhead erzeugen können. In der Praxis prüfst du das mit Befehlen wie `file -i datei.txt` in Linux, um den MIME-Typ und Charset zu sehen.

**Und vergiss nicht:** Verschlüsselung hier ist end-to-end, also checke Zertifikate mit `openssl s_client -connect server:443` , um sicherzustellen, dass TLS richtig formatiert ist.

🔧 **Praktisches Beispiel:** Du überträgst eine CSV-Datei von einem Linux-Server zu einem Client. Wenn Zeilenumbrüche (LF vs. CRLF) nicht passen, wird's unlesbar. Konvertiere mit:

```bash

iconv -f UTF-8 -t ISO-8859-1 input.csv -o output.csv

dos2unix output.csv

```

Das passt das Format an, simuliert die Arbeit von `Layer 6`. Teste es in einem Docker-Container für isolierte Umgebungen:

```bash

docker run -it ubuntu bash

apt update && apt install -y dos2unix iconv

# Dann die Befehle ausführen

```

❗ **Typische Fehlerquelle:** Ignorierte Kompression führt zu hohen Latenzen in langsamen Netzen. Lösung: Aktiviere gzip in Webservern wie Nginx via `gzip on;` in der Config – das komprimiert HTTP-Antworten automatisch. Oder bei Dateitransfers nutze `tar -czf archiv.tar.gz verzeichnis/`, um Daten vor dem Versand zu packen.

Wie nutzt du das später in der Praxis? Bei der Einrichtung von sicheren Verbindungen in Linux-Clustern, z.B. mit Kubernetes, wo du Secrets verschlüsselst. **Oder in Backup-Skripten:** Du komprimierst Logs mit `gzip` und sicherst ab, dass Empfänger sie dekomprimieren können. In Enterprise-Setups hilft es, APIs zu integrieren – stell sicher, dass JSON/XML formatiert ist, um Parsing-Fehler zu vermeiden.

So baust du robuste Systeme, die skalieren, ohne dass Formatprobleme den Betrieb stören.

**Darstellungsschicht in Aktion**

```Markdown

┌──────────────────────────────┐

│ Sender: Anwendungsdaten │

├──────────────────────────────┤

│ ↓ Formatierung/Kompression │

│ ↓ Verschlüsselung (z.B. TLS) │

│ ↓ Neutrales Netzwerkformat │

└──────────────────────────────┘

│

▼

Netzwerkübertragung

│

▼

┌──────────────────────────────┐

│ Empfänger: Neutrales Format │

├──────────────────────────────┤

│ ↑ Entschlüsselung │

│ ↑ Dekompression │

│ ↑ System-spezifisches Format │

└──────────────────────────────┘

```

⚠️ **Warnung:** In IoT-Netzwerken mit begrenzter Rechenpower vermeide schwere Verschlüsselung in `Layer 6`, da sie Geräte überlasten kann – wähle leichte Algorithmen wie `AES-128`.

### Layer 5: Sitzungsschicht

**Session Layer**

Kommen wir nun zur einer Schicht, die den Überblick über laufende Gespräche im Netzwerk behält.

`Layer 5` ist ähnlich wie ein Dirigent, der sicherstellt, dass Musiker im Takt bleiben. Die Sitzungsschicht verwaltet die Einrichtung, den Ablauf und das Beenden von Kommunikationssitzungen zwischen Anwendungen auf verschiedenen Geräten. Denk an eine Videokonferenz: Ohne diese Schicht würde der Stream unterbrechen, ohne dass du weißt, wo du weitermachen kannst. Sie koordiniert den Dialog, synchronisiert Datenströme und ermöglicht Wiederaufnahme nach Störungen, indem sie Checkpoints setzt – wie Lesezeichen in einem Buch.

Was genau passiert in dieser Schicht?

**Sie übernimmt das Sitzungsmanagement in drei Phasen:**

`Aufbau`, `Steuerung` und `Abbau`. Beim Aufbau werden Parameter wie `Authentifizierung`, `Duplex-Modus` (`full-duplex` für bidirektionale Kommunikation, `half-duplex` für abwechselnd) und Synchronisationsregeln vereinbart. Während der Steuerung sorgt sie für Ordnung – wer sendet wann, und wie werden mehrere Ströme (z.B. Audio und Video) kombiniert? Beim Abbau wird die Sitzung sauber beendet, um Ressourcen freizugeben. Protokolle wie `SIP` für `VoIP`, `RPC` für Fernaufrufe oder `NetBIOS` für lokale Netze greifen hier ein.

In Linux siehst du das bei Diensten wie `SSH`, wo Sessions mit `ssh user@host` aufgebaut werden, oder bei `systemd-logind`, das Benutzersitzungen handhabt.

Warum ist diese Schicht relevant? Sie verknüpft Anwendungen zuverlässig, was in verteilten Systemen entscheidend ist. Ohne sie könnten Cloud-Dienste wie Kubernetes-Pods nicht synchron laufen, oder IoT-Geräte würden Verbindungen verlieren. In der Systemintegration nutzt du das, um resiliente Netze zu bauen – denk an Failover in High-Availability-Clustern, wo Checkpoints Datenverlust verhindern.

Es schützt auch vor Angriffen wie Session-Hijacking, wo Angreifer Sitzungen übernehmen, was in 2026 mit steigenden Cyberbedrohungen relevanter denn je ist.

💡 **Tipp:** Betrachte Layer 5 als den "Terminkalender" deines Netzwerks – er plant, wer wann spricht, und notiert Pausen, damit nichts verloren geht. Das hilft dir, wenn du später Docker-Container orchestrierst, wo Sessions über Netzwerke hinweg stabil bleiben müssen.

Worauf solltest du besonders achten? Auf Dialog-Kontrollmodi: `Simplex` (einseitig, wie Broadcasting), `Half-Duplex` (abwechselnd, wie Walkie-Talkie) oder `Full-Duplex` (gleichzeitig, wie Telefon). Synchronisation ist key – Checkpoints markieren Punkte, an denen nach einem Abbruch fortgefahren wird, z.B. bei Dateiübertragungen. Achte auf Protokolle wie `L2TP`, `PPTP` für VPNs oder `WebRTC` für Echtzeit-Kommunikation.

In Linux prüfst du Sessions mit `who` oder `loginctl list-sessions`, um laufende Benutzersitzungen zu sehen. **Und vergiss nicht:** Diese Schicht interagiert eng mit `Layer 4` (Transport), das die Segmente liefert, und `Layer ` (Darstellung), das die Formatierten Daten bereitstellt.

🔧 **Praktisches Beispiel:**

Du managst SSH-Sessions auf einem Server. Starte eine mit:

```bash

ssh user@remote-host

```

**m Sessions zu überwachen, nutze:**

```bash

loginctl list-sessions

loginctl show-session

```

**In einem Docker-Setup für Testumgebungen:**

```bash

docker run -d -p 22:22 --name ssh-container rastasheep/ubuntu-sshd:18.04

ssh root@localhost -p 22 # Passwort: root

```

Das simuliert Session-Management – beende mit `exit`, und checke Logs mit `docker logs ssh-container`.

❗ **Typische Fehlerquelle:** Fehlende Synchronisation führt zu Dateninkonsistenzen, z.B. bei unterbrochenen Downloads. Lösung: Implementiere Checkpoints in Skripten, wie mit `rsync --partial` für teilweise Übertragungen, das Sessions resilient macht. Oder bei APIs: Verwende Tokens für Stateful Sessions, um Hijacking zu vermeiden.

Wie nutzt du das später in der Praxis? Bei der Konfiguration von VoIP-Systemen wie `Asterisk` auf Linux, wo `SIP Sessions` koordiniert. **Oder in Cloud-Umgebungen:** `Kubernetes` verwendet Sessions für Pod-Kommunikation, und du setzt Checkpoints mit StatefulSets. In Backup-Routinen synchronisierst du Datenströme mit Tools wie `rclone`, das Abbrüche handhabt.

So stellst du sicher, dass Enterprise-Netze – von 5G bis Edge-Computing – stabil laufen, ohne dass Nutzer Unterbrechungen bemerken.

**Sitzungsschicht-Phasen**

```Markdown

Sitzungsschicht-Phasen

┌─────────────────────────────┐

│ Phase 1: Aufbau │

├─────────────────────────────┤

│ - Authentifizierung │

│ - Modus vereinbaren │

│ - Parameter setzen │

└─────────────────────────────┘

│

▼

┌─────────────────────────────┐

│ Phase 2: Steuerung │

├─────────────────────────────┤

│ - Dialog kontrollieren │

│ - Synchronisation (Checks) │

│ - Ströme kombinieren │

└─────────────────────────────┘

│

▼

┌─────────────────────────────┐

│ Phase 3: Abbau │

├─────────────────────────────┤

│ - Sauberes Beenden │

│ - Ressourcen freigeben │

│ - Logs sichern │

└─────────────────────────────┘

```

⚠️ ** Warnung:** In Zeiten von Zero-Trust vermeide offene Sessions – aktiviere Timeouts in SSH mit `ClientAliveInterval 300` in sshd_config, um inaktive Verbindungen zu trennen und Angriffe zu minimieren.

### Layer 4: Transportschicht

**Transport Layer**

Jetzt betreten wir die erste Schicht, die echte `End-to-End-Kommunikation` zwischen Sender und Empfänger herstellt

Unabhängig davon, wie viele Router oder Switches dazwischen liegen. Die Transportschicht segmentiert die Daten aus der Sitzungsschicht, packt sie in transportfähige Einheiten (Segmente bei `TCP`, Datagramme bei `UDP`) und sorgt dafür, dass sie zuverlässig oder schnell beim Zielprozess ankommen.

**Hier werden Ports eingeführt:** Die Schicht entscheidet, welche Anwendung auf dem Zielrechner die Daten bekommen soll. Ohne `Layer 4` wüsste der Empfänger nicht, ob ein Paket für den Webserver (Port `443`), SSH (Port `22`) oder einen Kubernetes-Pod (z. B. Port `8080`) gedacht ist.

Was genau passiert hier?

**Die Schicht übernimmt vier Kernaufgaben:**

- 1. Segmentierung und Reassemblierung – große Datenströme werden in handliche Segmente zerlegt und auf der Empfängerseite wieder zusammengesetzt.

- 2. Port-Adressierung – Quell- und Zielport werden in den Header geschrieben (16 Bit → 0–65535).

- 3. Verbindungssteuerung – TCP baut eine virtuelle Verbindung auf, UDP nicht.

- 4. Fluss- und Überlaststeuerung – TCP verhindert, dass der Empfänger überfordert wird (Windowing) und passt die Sendegeschwindigkeit an Netzwerkauslastung an.

Die zwei wichtigsten Protokolle sind `TCP` und `UDP` – und genau hier entscheidet sich, ob deine Anwendung zuverlässig oder performant sein soll.

💡 **Tipp:** Merke dir den Unterschied so: `TCP` ist der zuverlässige Paketdienst mit Sendungsverfolgung und Nachnahme, `UDP` ist der Brief ohne Rückschein – schnell, aber wenn er verloren geht, merkst du es erst später (oder gar nicht).

**TCP – das zuverlässige Arbeitstier**

Verbindungsbasiert, mit `3-Way-Handshake`, `Sequenznummern`, `ACKs`, `Retransmission` und `Congestion Control`. Perfekt für `HTTP/S`, `SSH`, `E-Mail`, `ateitransfers` – überall dort, wo kein Bit fehlen darf.

```Markdown

TCP 3-Way-Handshake

┌────────┐ SYN ┌────────┐

│ Client │ ─────────────────────► │ Server │

└────────┘ └────────┘

◄─────────────── SYN/ACK

───────────────────► ACK

Verbindung steht

```

**UDP – der Geschwindigkeitskönig**

Verbindungslos, kein Handshake, keine Garantie. Dafür minimaler Overhead. Ideal für `DNS-Abfragen`, `VoIP`, `Streaming`, `Online-Gaming`, `NTP` – überall, wo Geschwindigkeit wichtiger ist als Vollständigkeit.

🔧 Praktisches Linux-Beispiel – Ports und Verbindungen prüfen:

```bash

# Alle lauschenden TCP/UDP-Ports anzeigen

ss -tuln

# Beispielausgabe entschlüsseln

Netid State Recv-Q Send-Q Local Address:Port Peer Address:Port

tcp LISTEN 0 128 0.0.0.0:22 0.0.0.0:* # SSH lauscht

tcp LISTEN 0 128 127.0.0.1:25 0.0.0.0:* # SMTP lokal

udp UNCONN 0 0 0.0.0.0:68 0.0.0.0:* # DHCP-Client

```

Mit `ss -tunap` siehst du sogar, welcher Prozess den Port belegt – Gold wert beim Troubleshooting.

🔧 **TCP-Verbindungsaufbau live mit tcpdump beobachten:**

```bash

sudo tcpdump -i eth0 tcp port 443 -n

# Öffne dann im Browser https://example.com

# Du siehst SYN → SYN/ACK → ACK

```

❗ **Typische Fehlerquelle bei Einsteigern:** Du blockierst mit der Firewall (z. B. `ufw`) nur TCP-Port `80`, aber HTTPS (TCP `443`) bleibt offen. Oder du vergisst, dass `UDP` keine Verbindung aufbaut – bei DNS-Problemen siehst du mit `dig @8.8.8.8 google.com` sofort, ob Port `53/UDP` blockiert ist.

Praktisches Firewall-Beispiel mit nftables (modernes Standard unter Ubuntu 24.04+ / Arch):

```bash

# Nur SSH und HTTPS erlauben, Rest verwerfen

sudo nft add table inet filter

sudo nft add chain inet filter input { type filter hook input priority 0 \; policy drop \; }

sudo nft add rule inet filter input tcp dport { 22, 443 } accept

sudo nft add rule inet filter input iif lo accept # Loopback freigeben

```

Das ist Layer-4-Firewalling pur – du filterst nach Port und Protokoll.

Wie nutzt du das in der täglichen Admin-Praxis? Bei Container-Umgebungen wie `Docker` oder `Kubernetes` sind Ports das A und O. Ein Pod, der intern auf Port `8080` lauscht, wird über einen Service auf NodePort `30080` exponiert – genau hier arbeitest du mit `Layer 4`.

Mit `iptables -t nat -L -n -v` oder `nft list ruleset` siehst du die DNAT-Regeln, die den Traffic umleiten.

**Oder bei Performance-Tuning:**

TCP-Window-Scaling und Congestion-Algorithmus anpassen:

```bash

# Aktuellen Algorithmus prüfen

sysctl net.ipv4.tcp_congestion_control

# Auf bbr umstellen (gut für hohe Latenz/Leitung)

sudo sysctl -w net.ipv4.tcp_congestion_control=bbr

```

Das kann bei 1000 km entfernten Backup-Servern 30–50 % mehr Durchsatz bringen.

**Segment vs. Datagramm:**

```Markdown

TCP-Segment

┌───────────────────────────────────────┐

│ TCP-Header (Ports, Seq, ACK, Flags) │

├───────────────────────────────────────┤

│ Anwendungsdaten │

└───────────────────────────────────────┘

UDP-Datagramm

┌───────────────────────────────────────┐

│ UDP-Header (nur 8 Byte: Ports, Länge) │

├───────────────────────────────────────┤

│ Anwendungsdaten │

└───────────────────────────────────────┘

```

⚠️ **Warnung:** In Cloud- und Container-Umgebungen werden immer mehr UDP-basierte Protokolle eingesetzt (`QUIC`, `HTTP3`, `WireGuard`). Wer nur `TCP` im Kopf hat, übersieht schnell Sicherheitslücken oder Performance-Probleme – prüfe immer beide Protokolle mit `ss -u` für `UDP` und `ss -t` für `TCP`.

`Layer 4` ist die Schicht, in der du als Admin am meisten Zeit verbringst – Ports öffnen, Verbindungen debuggen, Firewall-Regeln schreiben und Performance optimieren. Beherrschst du sie, hast du 80 % aller Netzwerkprobleme im Griff.

### Layer 3: Vermittlungsschicht

**Network Layer**

Hier landen wir nun bei der Schicht, die das Netzwerk wirklich verbindet

Sie sorgt dafür, dass Daten nicht nur lokal, sondern über verschiedene Netze hinweg ihr Ziel erreichen. Die Vermittlungsschicht handhabt die logische Adressierung und das Routing von Paketen, also die Entscheidung, welchen Weg die Daten nehmen sollen. Stell dir vor, du schickst eine E-Mail von deinem Server an einen Freund in einem anderen Land: `Layer 3` packt die Segmente aus der Transportschicht in IP-Pakete, weist logische Adressen zu (wie IP-Adressen) und leitet sie durch Router weiter.

Ohne diese Schicht blieben Netzwerke auf lokale Bereiche beschränkt, und das Internet, wie wir es kennen, wäre unmöglich.

Was genau passiert in dieser Schicht?

**Sie übernimmt die Paketierung:** Segmente werden in Pakete umgewandelt, mit Headern versehen, die Quell- und Ziel-IP enthalten, `TTL` (Time to Live, um Endlosschleifen zu verhindern) und weitere Infos wie Fragmentierung für zu große Pakete. Routing ist der Kern – Router schauen in Routing-Tabellen und wählen den besten Pfad basierend auf Metriken wie Hop-Count oder Bandbreite. Protokolle wie `IP` (`IPv4`, `IPv6`), `ICMP` (für Ping und Fehler), `IGMP` (Multicast) und Routing-Protokolle (`RIP`, `OSPF`, `BGP`) laufen hier.

In Linux siehst du das bei `ip route show`, wo du siehst, wie Pakete geroutet werden.

Warum ist diese Schicht relevant? Sie ist der Grundstein für skalierbare Netze – ohne Routing gäbe es kein `WAN`, keine Cloud-Connectivity oder `VPNs`. In der Systemintegration hilft dir das, `Subnetze` zu planen, `NAT` zu konfigurieren und Traffic zu optimieren. Besonders in 2026, mit dem Boom von`IPv6` und Edge-Computing, musst du hier fit sein, um Migrationen zu managen oder Sicherheitsregeln in Firewalls zu setzen, die auf IPs basieren.

💡 **Tipp:** Denk an `Layer 3` wie an eine Postzentrale – sie sortiert Briefe nach Adressen und wählt die Route (Auto, Zug, Flugzeug), aber kümmert sich nicht um den Inhalt oder die Zustellgarantie (das ist `Layer 4`).

Worauf solltest du besonders achten?

**Auf IP-Adressierung:** `IPv4` (32 Bit, z.B. `192.168.1.1`) ist knapp, `IPv6` (128 Bit, z.B. `2001:db8::1`) unendlich. Subnetting teilt Netze ein (CIDR-Notation wie /24), um Kollisionen zu vermeiden. Fragmentierung splittet Pakete, wenn MTU (Max Transmission Unit) überschritten wird – check das mit `ip link show`.

**Und Routing:** Statisch (manuell) vs. dynamisch (Protokolle lernen Routen). In Linux setzt du statische Routen mit `ip route add`.

🔧 **Praktisches Beispiel:**

Konfiguriere ein statisches Routing auf Ubuntu, um ein Subnetz zu erreichen:

```bash

# Aktuelle Routen anzeigen

ip route show

# Statische Route hinzufügen (z.B. zu 10.0.0.0/24 über Gateway 192.168.1.1)

sudo ip route add 10.0.0.0/24 via 192.168.1.1 dev eth0

# IPv6-Route hinzufügen

sudo ip -6 route add 2001:db8:1::/64 via 2001:db8::1 dev eth0

```

Teste mit `ping 10.0.0.1` oder `ping6 2001:db8:1::1` – wenn's nicht geht, liegt's oft an falschem Gateway.

**In Docker:** Bei Netzwerken wie bridge oder overlay siehst du Layer-3-Routing in Aktion. Erstelle ein Custom-Netz:

```bash

docker network create --subnet=172.18.0.0/16 mynet

docker run -d --network mynet --ip 172.18.0.2 nginx

# Von Host aus pingen: ping 172.18.0.2

```

❗ Typische Fehlerquelle: IP-Konflikte oder falsche Subnet-Masken – Pakete kommen nicht an. Lösung: Nutze `arp -a` für ARP-Tabellen (die IP zu MAC auflösen) oder `traceroute google.com`, um den Pfad zu tracken und Engpässe zu finden.

Wie nutzt du das später in der Praxis?

**Bei VPN-Setups mit WireGuard:** Du routest Traffic durch Tunnel (`Layer 3`). Oder in Kubernetes: Ingress-Controller handhaben Routing auf IP-Ebene. **Für Security:** Setze ACLs in Routern oder mit `nftables` – blockiere IPs:

```bash

sudo nft add table ip filter

sudo nft add chain ip filter input { type filter hook input priority 0 \; policy accept \; }

sudo nft add rule ip filter input ip saddr 192.168.1.100 drop # Blockiere eine IP

```

Das schützt vor Spoofing. In großen Netzen optimierst du mit OSPF via FRR-Daemon – installiere mit `apt install frr` und konfiguriere /etc/frr/frr.conf.

**Routing-Prozess:**

```Markdown

Routing in Layer 3

┌──────────────┐

│ Quelle: │

│ 192.168.1.10 │

└──────┬───────┘

│ Paket mit Ziel-IP 8.8.8.8

▼

┌──────────────┐

│ Router 1 │ ← Schaut in Routing-Tabelle: Nächster Hop?

│ Gateway │

└──────┬───────┘

│ Via ISP-Router

▼

┌──────────────┐

│ Router 2 │ ← TTL dekrementiert, Fragmentierung bei Bedarf

└──────┬───────┘

│

▼

┌──────────────┐

│ Ziel: │

│ 8.8.8.8 │

└──────────────┘

```

⚠️ **Warnung:** Bei IPv6-Migration achte auf Dual-Stack – viele Systeme fallen auf IPv4 zurück, was Latenzen verursacht. Aktiviere IPv6 mit `sysctl -w net.ipv6.conf.all.disable_ipv6=0` und teste mit `ip -6 addr show`.

### Layer 2: Sicherungsschicht

**Data Link Layer**

Layer 2 oder Sicherungsschicht ist die Schicht, die den Übergang vom Logischen zum Physischen markiert – sie organisiert die Daten in Frames und sorgt für eine fehlerfreie Übertragung über ein lokales Medium. Sie übernimmt Pakete aus der Vermittlungsschicht, rahmt sie ein (Framing), fügt physische Adressen hinzu (MAC-Adressen) und erkennt Fehler durch Checksummen.

Stell dir vor, du verbindest zwei Linux-Maschinen über einen Switch: `Layer 2` stellt sicher, dass Frames korrekt ankommen, ohne dass höhere Schichten eingreifen müssen. Sie handhabt auch den Zugriff auf das Medium (z.B. `CSMA`, `CD` bei `Ethernet`) und ermöglicht Punkt-zu-Punkt- oder Broadcast-Kommunikation in LANs.

Was genau passiert in dieser Schicht?

**Sie teilt sich in zwei Subschichten:** `LLC` (Logical Link Control) für Flow-Control und Fehlerkorrektur, und `MAC` (Media Access Control) für Adressierung und Mediumszugriff. Frames bekommen Header (z.B. `Ziel-MAC`, `Quell-MAC`, `Länge`) und `Trailer` (CRC für Fehlererkennung). Wenn Fehler erkannt werden, fordert sie Retransmission an (z.B. via `ARQ`). Protokolle wie `Ethernet`, `PPP`, `Wi-Fi` (802.11) oder `VLANs` (802.1Q) sind hier zu Hause.

In Linux siehst du das bei `ip link show`, wo du MTU, MAC und Status der Interfaces prüfst.

Warum ist diese Schicht relevant? Sie ist der Schlüssel zu lokalen Netzen – ohne sie könnten Switches nicht lernen, wohin Frames gehen, und dein Home-Lab würde kollabieren. In der Systemintegration hilft dir das, VLANs zu segmentieren, um Traffic zu isolieren, oder Bridges zu bauen für virtuelle Netze. Besonders in Container-Umgebungen wie `Docker`, wo virtuelle Interfaces (veth) `Layer 2` simulieren, brauchst du das, um Netzwerk-Isolierung zu managen.

💡 **Tipp:** Sieh `Layer 2` als den "Postboten im Haus" – er liefert Briefe an die richtige Wohnung (MAC), aber nur im Gebäude (LAN), nicht über die Stadt (das ist `Layer 3`).

Worauf solltest du besonders achten? Auf MAC-Adressen (48 Bit, z.B. `00:11:22:33:44:55`), die hardwarebasiert sind und via `ARP` zu IPs resolved werden. Framing verhindert, dass Bits als ein endloser Strom gesehen werden – Preambel und Delimiter markieren Anfang/Ende. Fehlererkennung nutzt `CRC` oder `Parity`, aber Korrektur ist optional (meist nur Erkennung). In drahtlosen Netzen achte auf `CSMA,`, `CA`, um Kollisionen zu vermeiden.

In Linux änderst du MAC mit `ip link set dev eth0 address 00:aa:bb:cc:dd:ee` – nützlich für Tests.

🔧 **Praktisches Beispiel:**

Überwache Frames mit ethtool und tcpdump auf Ubuntu:

```bash

# Interface-Details anzeigen (MTU, Duplex, Speed)

ethtool eth0

# MAC ändern (temporär)

sudo ip link set eth0 down

sudo ip link set eth0 address 00:11:22:33:44:55

sudo ip link set eth0 up

# Frames sniffen

sudo tcpdump -i eth0 -e -nn # -e zeigt Layer-2-Header (MAC)

```

**In Docker:** Erstelle ein Bridge-Netz, das `Layer 2` simuliert:

```bash

docker network create --driver bridge mybridge

docker run -d --network mybridge busybox sleep infinity

# Inspiziere: docker network inspect mybridge # Zeigt MACs der Container

```

❗ **Typische Fehlerquelle:** Duplex-Mismatch (ein Gerät full-duplex, das andere half) führt zu Kollisionen und Paketverlust. Lösung: Setze mit `ethtool -s eth0 autoneg off speed 1000 duplex full` – aber teste erst mit `mii-tool`.

Wie nutzt du das später in der Praxis? Bei VLAN-Konfiguration mit `vlan`-Modul: Lade es mit `modprobe 8021q` und erstelle Interfaces via `ip link add link eth0 name eth0.10 type vlan id 10`. Das segmentiert Traffic für sichere Zonen. In Kubernetes nutzt du Calico oder Flannel für Layer-2-Overlays, um Pods zu verbinden.

**Für Security:** Implementiere MACsec (802.1AE) für verschlüsselte Frames – installiere `wpasupplicant` und konfiguriere. So schützt du LANs vor Sniffing.

**Frame-Aufbau:**

```Markdown

Ethernet-Frame

┌────────────┐ ┌────────────┐ ┌────────────┐ ┌────────────┐ ┌────────┐

│ Preambel │ │ Ziel-MAC │ │ Quell-MAC │ │ Typ/Länge │ │ CRC │

│ (7 Bytes) │ │ (6 Bytes) │ │ (6 Bytes) │ │ (2 Bytes) │ │ (4 B) │

└────────────┘ └────────────┘ └────────────┘ └────────────┘ └────────┘

│

▼

Nutzdaten (46-1500 Bytes)

```

### Layer 1: Bitübertragungsschicht

**Physical Layer**

Nun sind wir an der Basis angekommen, auf der alles aufbaut – die physische Schicht, die Bits als elektrische, optische oder drahtlose Signale überträgt.

Die Bitübertragungsschicht definiert, wie Daten als `0en` und `1en` über Kabel, Glasfaser oder Funkwellen gesendet werden, inklusive Spannungspegel, Bitraten, Stecker und Modulation.

**Stell dir vor, du steckst ein Ethernet-Kabel in deinen Linux-Server:** `Layer 1` sorgt dafür, dass die Signale physikalisch ankommen, ohne dass höhere Schichten involviert sind. Sie handhabt die Hardware-Schnittstelle, wie `NICs` (Network Interface Cards), `Hubs` oder `Repeater`, und stellt eine rohe Bitübertragung her – keine Adressierung oder Fehlerkorrektur, nur der pure Transport.

Was genau passiert in dieser Schicht?

Sie wandelt digitale Bits in analoge Signale um (Kodierung wie Manchester-Encoding) und umgekehrt. Parameter wie `Bitrate` (z.B. 1 Gbit/s), `Duplex-Modus` (full/half), `Medium` (Kupfer, Fiber, Wireless) und `Topologie` (Bus, Star, Ring) werden festgelegt. Standards wie `Ethernet` (IEEE 802.3), `Wi-Fi` (802.11) oder `RS-232` greifen ein.

In Linux siehst du das bei `ethtool -s eth0`, wo du Speed, Duplex und Autonegotiation prüfst – die Schicht ist rein hardwarebasiert, aber Tools geben Einblick.

Warum ist diese Schicht relevant ?

Ohne stabile physische Verbindung scheitert alles Obere – ein defektes Kabel blockt dein ganzes Netz. In der Systemintegration hilft dir das, Hardware-Probleme früh zu erkennen, z.B. bei Rack-Setups oder IoT-Deployment, wo Kabelqualität den Unterschied macht. Besonders in Datacentern mit 400G-Ethe

💡 **Tipp:** Betrachte Layer 1 als das Fundament deines Hauses – stabil, aber unsichtbar. Wenn's wackelt, merkst du's erst, wenn der Rest einstürzt. Das spart dir Stunden beim Debugging höherer Schichten.

Worauf solltest du besonders achten?

**Auf Medium-spezifische Limits:** `Kupfer` (Cat6 bis 100m bei 10G), `Fiber` (Single-Mode bis km-Weiten), `Wireless` (Frequenzen wie 2.4/5/6 GHz mit Interferenzen). Achte auf Synchronisation (`Clocking`), Signalstärke (`Attenuation`) und Rauschen (`SNR`). In drahtlosen Netzen prüfe Kanäle, um Overlap zu vermeiden.

In Linux teste mit `iwconfig wlan0` für Wi-Fi-Details oder `mii-tool eth0` für Kupfer-Status.

🔧 **Praktisches Beispiel:**

Überprüfe und setze Link-Parameter auf Ubuntu:

```bash

# Link-Status anzeigen

ip link show eth0

# Details mit ethtool

ethtool eth0 # Zeigt Speed, Duplex, MDI-X

# Speed/Duplex manuell setzen (z.B. für alte Hardware)

sudo ethtool -s eth0 autoneg off speed 100 duplex full

```

**In Docker:** Teste physische Verbindungen in Containern via Host-Interface:

```bash

docker run -it --network host ubuntu bash

ethtool eth0 # Greift auf Host's Layer 1 zu

```

❗ **Typische Fehlerquelle:** Falsche Kabelkategorie (z.B. Cat5 bei 10G) führt zu Bitfehlern. Lösung: Verwende `ethtool -t eth0` für Offline-Tests oder `ping -s 1500 -f target` , um MTU und Signalqualität zu prüfen – hoher Paketverlust deutet auf Layer-1-Probleme.

Wie nutzt du das später in der Praxis?

**Bei Server-Racks:** Wähle SFP-Module für `Fiber` (z.B. 10GBASE-SR) und konfiguriere mit `ip link set dev eth0 up`. In Wireless-Setups mit Hostapd baue APs auf: Installiere `hostapd` und editiere `/etc/hostapd/hostapd.conf` für Kanal/Signal. **Für Monitoring:** Integriere `lm-sensors` oder `ipmitool` , um Temperatur/Spannung zu checken, die Signale beeinflussen.

So baust du zuverlässige Infrastrukturen, z.B. für Kubernetes-Clusters, wo physische Links die Basis für Overlays bilden.

**Signalübertragung:**

```Markdown

Bitübertragung in Layer 1

┌──────────────┐

│ Sender-NIC │

└──────┬───────┘

│ Bits: 101010...

▼ Kodierung (z.B. NRZ)

┌──────────────┐

│ Medium │ ← Signal (elektrisch/optisch)

│ (Kabel/Funk) │ Attenuation, Rauschen

└──────┬───────┘

│

▼ Dekodierung

┌───────────────┐

│ Empfänger-NIC │

└───────────────┘

```

### Interaktion zwischen den Schichten

**Encapsulation und Decapsulation**

Jetzt, wo du die einzelnen Schichten kennst, lass uns betrachten, wie sie zusammenarbeiten – das ist der Kleber, der das OSI-Modell zum Leben erweckt.

**Encapsulation ist der Prozess beim Sender**

Daten werden schichtweise "verpackt", wobei jede Schicht Header (und manchmal Trailer) hinzufügt, die für ihre Aufgabe nötig sind.

**Decapsulation ist das Gegenteil beim Empfänger**

Die Schichten entfernen schrittweise diese Header, um die Originaldaten freizulegen. Stell dir vor, du sendest eine Datei per `SCP` von einem Linux-Server zu einem anderen: `Encapsulation` baut die Pakete auf, `Decapsulation` zerlegt sie – so wandern Bits sicher durchs Netz, ohne dass du den Prozess manuell steuern musst.

Was genau passiert bei Encapsulation?

**Es startet in `Layer 7`:**

Die Anwendungsdaten (z.B. eine JSON-Nachricht) werden an `Layer 6` weitergegeben, der `formatiert` und `verschlüsselt` (z.B. TLS-Header hinzufügt). `Layer 5` fügt Sitzungs-Infos hinzu (z.B. Token für Wiederaufnahme). `Layer 4` segmentiert und addiert TCP/UDP-Header (Ports, Sequenznummern). `ayer 3` paketiert mit IP-Header (IPs, TTL). `Layer 2` framed mit MAC-Header/Trailer (MACs, CRC). `Layer 1` wandelt schließlich in Signale um.

Jeder Header enthält Kontrollinfos, die die nächste Schicht braucht – das macht den Prozess modular und fehlertolerant.

**Beim Empfänger dreht sich alles um:**

`Layer 1` empfängt Signale und rekonstruiert Bits zu Frames. `Layer 2` prüft CRC, entfernt MAC-Header und gibt Pakete an `Layer 3`. `Layer 3` checkt IP, routet lokal und entfernt Header. `Layer 4` reassembliert Segmente, handhabt `ACKs` und liefert an `Layer 5`. `Layer 5` managt die Sitzung, `Layer 6` `dekomprimiert`, `entschlüsselt`, `Layer 7` präsentiert die reinen Daten der Anwendung.

In Linux siehst du das in Tools wie `Wireshark`, wo du den gesamten Stack dissectierst.

Warum ist diese Interaktion relevant? Sie erklärt, warum Netzwerke skalierbar sind – jede Schicht ist unabhängig, aber kooperativ. **In der Systemintegration hilft dir das, Probleme zu isolieren:** Wenn `Encapsulation` in `Layer 3` fehlschlägt (falsche IP), siehst du's in Logs, ohne den ganzen Stack zu `debuggen`. Besonders in containerisierten Umgebungen wie Docker, wo virtuelle Netze Encapsulation simulieren, brauchst du das, um Overheads zu minimieren und Performance zu optimieren.

💡 **Tipp:** Visualisiere `Encapsulation` wie das Verschicken eines Pakets: Du packst den Inhalt (Daten) in eine Box (Segment), adressierst (Paket), frankierst (Frame) und gibst ab (Bits). `Decapsulation` ist Auspacken – Schicht für Schicht, bis der Inhalt da ist.

Worauf solltest du besonders achten?

**Auf Overhead:** Jeder Header vergrößert die Payload (z.B. TCP-Header 20–60 Bytes, IP 20 Bytes) – in langsamen Netzen summiert sich das. Achte auf MTU (typisch 1500 Bytes), um `Fragmentierung` zu vermeiden, die `Decapsulation` kompliziert. In drahtlosen Netzen addiert ?Layer 1? Rauschen, was höhere Schichten belastet.

In Linux passe MTU mit `ip link set eth0 mtu 9000` für Jumbo-Frames an, aber nur wenn alle Geräte mitmachen.

🔧 **Praktisches Beispiel:** Analysiere Encapsulation mit tcpdump auf Ubuntu – capture eine HTTP-Anfrage:

```bash

sudo tcpdump -i eth0 -XX -c 10 port 80 # -XX zeigt Hex/ASCII, inkl. Header

# Starte curl http://example.com

# In der Ausgabe siehst du: Ethernet-Frame (Layer 2), IP-Paket (3), TCP-Segment (4), HTTP-Data (7)

```

**In Docker:** Simuliere mit zwei Containern – Encapsulation in virtuellen Interfaces:

```bash

docker network create mynet

docker run -d --name sender --network mynet busybox sleep infinity

docker run -d --name receiver --network mynet busybox sleep infinity

docker exec sender ping -c 1 receiver # tcpdump im Host zeigt Encapsulation

```

❗ **Typische Fehlerquelle:** Mismatched MTU führt zu "Black Hole"-Effekten – Pakete verschwinden, weil `Fragmentierung` blockiert ist. **Lösung:** Setze `ip link set eth0 mtu 1400` für VPN-Tunnel und teste mit `ping -M do -s 1472 target` (do = don't fragment).

Wie nutzt du das später in der Praxis?

**Bei Netzwerk-Debugging in Kubernetes:** Nutze `k9s` oder `kubectl exec` , um Pods zu sniffen – sieh, wie Calico `Encapsulation` für Overlays handhabt. **In Backup-Skripten:** `SCP` nutzt `SFTP` (`Layer 7`), aber `Encapsulation` sorgt für sichere Pakete – optimiere mit `rsync -z` für Kompression in `Layer 6`.

**Für Security:** `IPSec` addiert `Encapsulation` (AH/ESP-Header) – konfiguriere mit `StrongSwan` auf Linux, um Tunnel zu bauen. So stellst du sichere, effiziente Verbindungen her, z.B. in Hybrid-Clouds.

**Der Encapsulation-Prozess:**

```Markdown

Encapsulation (Sender)

┌──────────────┐

│ L7: Daten │

└──────┬───────┘

│ + L6 Header (Format)

▼

┌──────────────┐

│ L6: PDU │

└──────┬───────┘

│ + L5 Header (Session)

▼

┌──────────────┐

│ L5: PDU │

└──────┬───────┘

│ + L4 Header (Ports/Seq)

▼

┌──────────────┐

│ L4: Segment │

└──────┬───────┘

│ + L3 Header (IPs/TTL)

▼

┌──────────────┐

│ L3: Paket │

└──────┬───────┘

│ + L2 Header/Trailer (MACs/CRC)

▼

┌──────────────┐

│ L2: Frame │

└──────┬───────┘

│ → L1: Bits/Signale

▼

Decapsulation (Empfänger): Umgekehrt – Header entfernen ↑

```

### Missverständnisse und Tipps

Beim Einstieg ins OSI-Modell stolpern viele über ähnliche Fallstricke, besonders wenn du aus der Linux-Admin-Praxis kommst und dich fragst, warum ein theoretisches Modell in deinem Alltag mit `ip` oder `ethtool` relevant ist. Lass uns die gängigsten Missverständnisse aufklären und mit praxisnahen Tipps versehen, damit du sie vermeidest.

Als Einsteiger hilft das, das Modell nicht als trockene Theorie zu sehen, sondern als Werkzeugkasten für reale Probleme wie Netzwerk-Outages in einem Server-Cluster.

❗ **Missverständnis 1: Das OSI-Modell ist veraltet und wird nie in der Praxis verwendet – TCP/IP reicht aus.**

Viele denken so, weil `TCP/IP` das Internet dominiert und OSI **nur Theorie** ist. **Aber das stimmt nicht:** OSI dient als Referenz, um Probleme zu strukturieren. In Linux siehst du das, wenn du mit `wireshark` eine Capture analysierst – du filterst nach Schichten, z.B. `tcp.port == 80` für Layer 4/7. Starte immer mit OSI, um zu checken, ob ein Issue in `Layer 1` (Kabel) oder `Layer 3` (Routing) liegt.

**In der Praxis:** Bei einem Kubernetes-Cluster, der nicht kommuniziert, prüfst du schichtweise – oft ist's ein Layer-2-Switch-Loop, nicht der Pod-Code.

💡 **Tipp:** Übe mit `tcpdump -i any -nn` und filtere Schichten: `-e` für Layer 2 (MAC), `ip` für Layer 3. So siehst du, wie Theorie in Echtzeit-Paketen lebt.

❗ **Missverständnis 2: Die Schichten sind streng getrennt und interagieren nicht.**

Einsteiger glauben oft, jede Schicht arbeitet isoliert, aber `Encapsulation` zeigt das Gegenteil – Header aus höheren Schichten werden in niedrigere eingebettet. Das führt zu Fehlern, z.B. wenn du eine Firewall nur auf `Layer 4` setzt und `Layer 7` Angriffe (wie SQL-Injection via HTTP) durchlassen.

**In Linux:** `nftables` kann deep inspection machen, aber starte mit Basics.

**Tipp:** Bei Debugging nutze `strace` auf Netzwerk-Commands, z.B. `strace curl example.com`, um zu sehen, wie Syscalls Schichten berühren – von Socket-Creation (Layer 4) bis Send (Layer 1).

🔧 **Praktisches Beispiel:** Simuliere eine Fehldiagnose in Docker – ein Container erreicht den Host nicht:

```bash

docker run -it --rm ubuntu bash

# Im Container: ping 8.8.8.8 # Funktioniert (Layer 3+)

# Aber curl example.com schlägt fehl? Check Layer 7/4 mit telnet example.com 80

# Oft ist's DNS (Layer 7) – fix mit echo "nameserver 8.8.8.8" > /etc/resolv.conf

```

Das zeigt, wie Missverständnisse zu falschen Annahmen führen – teste schichtweise.

❗ **Missverständnis 3: Layer 1 ist nur Kabel – keine Software involviert.**

Viele unterschätzen, dass `Layer 1` softwaregesteuert ist, z.B. via Driver für NICs. Ein defekter Driver crasht dein ganzes Netz, nicht nur Hardware.

**In Linux:** `lspci -v | grep Ethernet` zeigt Kernel-Module.

💡 **Tipp:** Bei Link-Problemen lade Module neu mit `modprobe -r e1000 && modprobe e1000` – das fixxt oft "No carrier"-Errors, ohne Kabel zu wechseln.

**Häufige Fehlerquellen:**

```Markdown

┌────────────┬────────────────────────┬──────────────────────────────┐

│ Schicht │ Missverständnis │ Korrektur & Tipp │

├────────────┼────────────────────────┼──────────────────────────────┤

│ L7 (App) │ "Nur GUI" │ Involviert Protokolle; │

├────────────┼────────────────────────┼──────────────────────────────┤

│ L4 (Trans) │ "TCP=zuverlässig │ UDP für Speed; check Ports │

│ │ immer" │ mit ss -tuln │

├────────────┼────────────────────────┼──────────────────────────────┤

│ L3 (Net) │ "Lokales Routing │ Global via BGP; trace mit │

├────────────┼────────────────────────┼──────────────────────────────┤

│ L2 (Data) │ "Nur Switches" │ VLANs segmentieren; set mit │

│ │ │ vconfig │

├────────────┼────────────────────────┼──────────────────────────────┤

│ L1 (Phys) │ "Rein Hardware" │ Driver managen mit ethtool │

└────────────┴────────────────────────┴──────────────────────────────┘

```

❗ **Missverständnis 4: Encapsulation ist nur Theorie – in Linux irrelevant.**

**Falsch:**Jeder `ping` encapsuliert ICMP in IP in Ethernet. Miss das, und du verstehst nicht, warum Jumbo-Frames (große MTU) Speed boosten.

💡 **Tipp:** Setze MTU hoch mit `ifconfig eth0 mtu 9000` und teste Throughput mit `iperf` – sieh, wie weniger Encapsulation-Overhead Bandbreite spart.

🔧 **Praktisches Beispiel:** In einem LXC-Container (ähnlich Docker) debugge Encapsulation:

```bash

lxc-create -n test -t download -- --dist ubuntu --release focal --arch amd64

lxc-start -n test

lxc-attach -n test

# Im Container: apt install tcpdump

tcpdump -i any -nn -c 5 icmp # Sieh Encapsulation bei ping vom Host

```

Das trainiert dich, Missverständnisse durch Beobachtung zu korrigieren.

⚠️ **Warnung:** Vermeide den Fehler, Schichten zu überspringen – z.B. direkt Layer 7 debuggen, wenn Layer 1 down ist. Starte immer unten: `ethtool eth0 | grep Link` für Layer 1, dann hoch. In Cloud-Setups wie AWS VPC sparst du Stunden.

Diese Tipps machen dich fit für die Praxis – übe in einem VM-Lab, und du merkst, wie OSI dein Admin-Leben erleichtert.

## Anwendung und Fehlersuche

Jetzt, wo du die Theorie der sieben Schichten verinnerlicht hast, lass uns das Ganze in die Praxis umsetzen.

Das ist der Teil, der dir zeigt, wie das OSI-Modell bei realen Netzwerkproblemen hilft. Hier lernst du, Tools wie `Wireshark` einzusetzen, um Datenverkehr zu analysieren, und systematisch Fehler zu jagen.

Als Einsteiger wirst du merken, wie das Modell dir einen klaren Pfad gibt: Statt wild rumzuprobieren, checkst du schichtweise, ob alles passt. In Linux-Umgebungen, z.B. bei der Fehlersuche in einem Docker-Cluster oder einem Home-Server, wird das dein tägliches Brot.

Was passiert hier? Du nimmst theoretische Konzepte und wendest sie auf echten Traffic an. Wireshark, das führende Open-Source-Tool für Paketanalyse, lässt dich den Datenfluss auf allen Schichten beobachten – von Bits (`Layer 1`) bis Anwendungsdaten (`Layer 7`).

Du startest Captures, filterst nach Protokollen und dissectierst Pakete, um zu verstehen, wo's hakt. Das ist essenziell, um Engpässe zu finden oder Sicherheitslücken zu schließen.

Warum ist das relevant?

**In der Admin-Praxis sparst du Stunden:** Ein "Keine Verbindung"-Fehler könnte am Kabel (`Layer 1`) liegen oder am Routing (`Layer 3`) – das Modell leitet dich. Besonders in modernen Setups wie Kubernetes, wo Pods über Netzwerke kommunizieren, hilft dir das, Ausfälle schnell zu lokalisieren und Systeme stabil zu halten.

Worauf solltest du besonders achten? Auf die aktuelle Wireshark-Version – Stand Februar 2026 ist `4.6.3` der Stable-Release, mit Verbesserungen in der Protokollinspektion und Performance-Optimierungen. Installiere es auf Ubuntu via `sudo apt install wireshark` und erlaube non-root-Captures mit `sudo dpkg-reconfigure wireshark-common`.

**Achte auf Filter-Syntax:** z.B. `http` für `Layer 7` oder `ip.src == 192.168.1.1` für `Layer 3`. **Und immer:** Capture nur was nötig, um Speicher zu schonen.

🔧 **Praktisches Beispiel:**

Starte Wireshark und capture Traffic – ideal für dein Linux-Setup:

```bash

sudo wireshark &

# Wähle Interface (z.B. eth0), starte Capture

# Öffne Browser, lade eine Seite – stoppe und analysiere

```

Das zeigt dir den vollen Stack in Echtzeit.

❗ **Typische Fehlerquelle:** Du captur'st alles und ertrinkst in Daten. Lösung: Filter vorab, z.B. `tcp.port == 80 or tcp.port == 443`, um nur Web-Traffic zu sehen. Oder exportiere Captures mit `tshark -r capture.pcap -Y "http" -T fields -e frame.time -e ip.src -e http.request.uri` für CLI-Analyse.

### Übung 1: HTTP-Verbindung analysieren

Hier übst du, eine Web-Anfrage schichtweise zu zerlegen – super für Einsteiger, um den Datenfluss zu greifen. Du siehst den TCP-Handshake (`Layer 4`), IP-Routing (`Layer 3`) und HTTP-Requests (`Layer 7`).

- Was passiert hier? Wireshark capturt den Verbindungsaufbau und zeigt, wie Pakete durch die Schichten wandern.

- Warum ist das relevant? In der Praxis debuggst du so langsame Websites oder Verbindungsabbrüche in deinem Linux-Webserver.

- Worauf solltest du achten? Auf den 3-Way-Handshake – SYN, SYN/ACK, ACK – und RTT (Round-Trip-Time) für Latenz.

- Wie nutzt du das später in der Praxis? Bei Nginx- oder Apache-Setups: Analysiere, ob SSL-Handshakes (Layer 6) fehlschlagen, und optimiere mit `nginx -t` für Config-Fehler.

**HTTP-Verbindungsaufbau**

```Markdown

┌──────┐ ┌──────┐

│Client│ │Server│

└──┬───┘ └──┬───┘

│ ──TCP SYN──► │ ← Layer 4: Transport

│ ◄─TCP SYN/ACK─ │

│ ──TCP ACK──► │

│ │

│ ──HTTP GET──► │ ← Layer 7: Anwendung

│ ◄─HTTP 200 OK─ │

│ ──TCP FIN──► │ ← Sitzung beenden (Layer 5)

│ ◄─TCP FIN/ACK─ │

```

**Aufgabe:**

- Installiere Wireshark (Version 4.6.3) und starte es.

- Wähle dein Interface, filtere mit `http`.

- Öffne einen Browser, besuche eine Site wie example.com.

- Stoppe Capture und identifiziere:

- Layer 4: TCP-Handshake und Ports

- Layer 3: IP-Adressen und TTL

- Layer 7: HTTP-Methoden (GET/POST) und Status-Codes

💡 **Tipp:** Farbcodierung in Wireshark hilft – rote Pakete deuten auf Fehler hin. Passe Filter an: `frame contains "GET"` für spezifische Requests.

### Übung 2: Protokoll-Analyse

Nun vertiefst du dich in den Paketaufbau – du lernst, Header zu dissectieren und zu sehen, wie Encapsulation arbeitet.

- Was passiert hier? Du zoomst in ein Paket rein und siehst Schichten gestapelt: HTTP über TCP über IP über Ethernet.

- Warum ist das relevant? Hilft dir, Protokoll-spezifische Issues zu finden, z.B. falsche IP-Header in einem VPN-Tunnel.

- Worauf solltest du achten? Auf Header-Größen – zu viel Overhead frisst Bandbreite. Check CRC in Layer 2 für Bitfehler.

- Wie nutzt du das später in der Praxis? Bei Docker-Netzwerken: Analysiere, ob Overlays (Layer 2/3) Pakete korrekt encapsulieren, mit `docker network inspect`.

**Paketaufbau in Wireshark**

```Markdown

Paketaufbau in Wireshark

┌────────────────────┐

│ HTTP-Header │ ← Layer 7: Method, URI, Status

├────────────────────┤

│ TCP-Header │ ← Layer 4: Ports, Seq, ACK, Flags

├────────────────────┤

│ IP-Header │ ← Layer 3: IPs, TTL, Protocol

├────────────────────┤

│ Ethernet-Frame │ ← Layer 2: MACs, Type, CRC

└────────────────────┘

```

**Aufgabe:**

- Öffne eine Capture in Wireshark.

- Wähle ein Paket, erweitere die Details.

- Notiere Header-Infos: z.B. TCP-Flags (SYN) oder IP-Fragmentation.

- Exportiere als JSON mit `tshark -r capture.pcap -T json` für Skripting.

⚠️ **Warnung:** Bei sensiblen Daten maskiere IPs mit Wireshark's Edit → Preferences → Protocols → IP → Resolve Names, um Privatsphäre zu wahren.

### Übung 3: Fehlersuche

Hier lernst du, Probleme systematisch anzugehen – vom Physischen hoch zur Anwendung.

- Was passiert hier? Du simulierst Fehler und nutzt das Modell, um sie zu lokalisieren.

- Warum ist das relevant? Spart Zeit in Outages: z.B. in einem Linux-Cluster, wo ein Pod nicht erreicht wird.

- Worauf solltest du achten? Starte unten: Link-Status (Layer 1), dann MAC (2), IP (3) usw. Ignoriere keine Logs.

- Wie nutzt du das später in der Praxis? In Systemd-Netzwerken: `networkctl status` zeigt Layer-1/2-Infos, kombiniert mit Wireshark für höhere Schichten.

**Problemanalyse-Strategie**

```Markdown

Problemanalyse-Strategie

┌─────────────┐

│ Symptom: │

│ Keine │

│ Verbindung │

└─────┬───────┘

│

┌─────▼───────┐

│ Layer 1: │ ← Kabel/Link ok? (ethtool eth0)

├─────────────┤

│ Layer 2: │ ← MAC/ARP ok? (arp -a)

├─────────────┤

│ Layer 3: │ ← IP/Routing ok? (ip route)

├─────────────┤

│ Layer 4: │ ← Ports offen? (ss -tuln)

├─────────────┤

│ Layer 5-7: │ ← App/Protokoll? (curl -v)

└─────────────┘

```

**Aufgabe:**

- 1. Simuliere einen Fehler: Ziehe ein Kabel (Layer 1) oder blockiere einen Port mit `ufw deny 80`.

- 2. Capture mit Wireshark, identifiziere die Schicht.

- 3. Fixe und verifiziere: z.B. `ufw allow 80` und recapture.

💡 **Tipp:** Integriere Wireshark in Skripte mit tshark für Automatisierung – z.B. `tshark -i eth0 -f "tcp port 80" -c 100 > log.txt` für Batch-Analyse.

❗ **Typische Fehlerquelle:** Du suchst in `Layer 7`, aber's liegt an `Layer 1` (schlechtes Signal). **Lösung:** Nutze `mtr target` für kombinierten Ping/Traceroute, das Layers 1-3 abdeckt.

Durch diese Übungen baust du Selbstvertrauen auf – probier's in einem VM-Lab aus, und du bist ready für echte Netzwerk-Challenges.

## Weiterführende Ressourcen

#### Offizielle Dokumentationen

Um tiefer in die Materie einzutauchen, greif auf bewährte Quellen zurück, die dir fundierte Einblicke geben. Diese Dokumente bilden die Basis für jedes seriöse Netzwerkstudium und helfen dir, theoretische Konzepte mit standardisierten Spezifikationen abzugleichen.

Als Einsteiger fang mit den Benutzerhandbüchern an, bevor du zu den RFCs übergehst – sie sind oft trocken, aber essenziell für Zertifizierungen wie [LPIC](https://www.lpi.org/our-certifications/lpic-1-overview/){.badge-link-text} oder [CCNA](https://www.cisco.com/site/us/en/learn/training-certifications/certifications/enterprise/ccna/index.html){.badge-link-text}.

- [Wireshark Benutzerhandbuch](https://www.wireshark.org/docs/){.badge-link}

- [RFC 1122 – Internet Standard Protocols](https://datatracker.ietf.org/doc/html/rfc1122){.badge-link}

- [ISO/IEC 7498-1 – OSI Basic Reference Model](https://www.iso.org/standard/20269.html){.badge-link}

### Praktische Lernressourcen

Hier findest du Plattformen und Simulatoren, die dir helfen, das OSI-Modell hands-on zu erproben, ohne teure Hardware. Ideal für dein Home-Lab oder Vorbereitung auf Prüfungen – baue virtuelle Netze auf und simuliere Fehler, um Troubleshooting zu üben.

- [Cisco Networking Academy](https://www.netacad.com/){.badge-link}

- [Packet Tracer – Netzwerk Simulator](https://www.netacad.com/courses/packet-tracer){.badge-link}

- [GNS3 – Netzwerk Emulator](https://www.gns3.com/){.badge-link}

##### Tools und Utilities

Diese Werkzeuge sind dein Arsenal für tägliche Netzwerkaufgaben – von Scanning bis Emulation. Wähle basierend auf deiner Distro, z.B. Ubuntu, und update regelmäßig via `apt`.

- [Wireshark – Protokoll-Analyzer](https://www.wireshark.org/){.badge-link}

- [Nmap – Netzwerk-Scanner](https://nmap.org/){.badge-link}

## Fazit

Das OSI-Modell bleibt dein zuverlässiger Kompass in der Netzwerkwelt – es zerlegt komplexe Abläufe in handhabbare Teile und macht Troubleshooting effizient. Du hast gesehen, wie die Schichten von der physischen Bitübertragung bis zur Anwendung interagieren, und wie Tools wie Wireshark das sichtbar machen. In Linux-Umgebungen, ob bei Server-Setups oder Container-Netzen, nutzt du das täglich, um Stabilität zu gewährleisten.

**Denk dran:** Jede Schicht löst spezifische Herausforderungen, von Routing-Problemen bis zu Protokollfehlern. Mit diesem Wissen baust du robuste Systeme auf, die skalieren und sicher sind.

💡 **Tipp:** Fang klein an: Nimm dein nächstes Netzwerkproblem und wende OSI an – starte mit [Layer 1](#layer-1-bituebertragungsschicht){.badge-link-text}, check Kabel und Link-Status via `ethtool eth0`. Du wirst merken, wie schnell du zur Lösung kommst, statt stundenlang zu raten.

**In deinem Linux-Lab:** Baue ein simples Setup mit Docker-Netzen und analysiere Traffic – das schärft dein Verständnis und macht dich selbstsicherer. Später, bei größeren Projekten wie Cloud-Migrationen, sparst du Zeit und Ressourcen. Bleib dran, probier's aus – je öfter du OSI einsetzt, desto natürlicher wird's. Du schaffst das, und es lohnt sich für deine Karriere!